2025-08-05作者:大湾区国际数据中心大会暨展览会

在大规模复杂网络中,采用层次化的负载均衡方式更加行之有效,通过不同层级的负载均衡的配合,弥补单一负载均衡方案的缺陷,以更好达到全网流量均衡和高吞吐的目的。层次化负载均衡方案主要包括以下技术内容:

全局负载均衡:

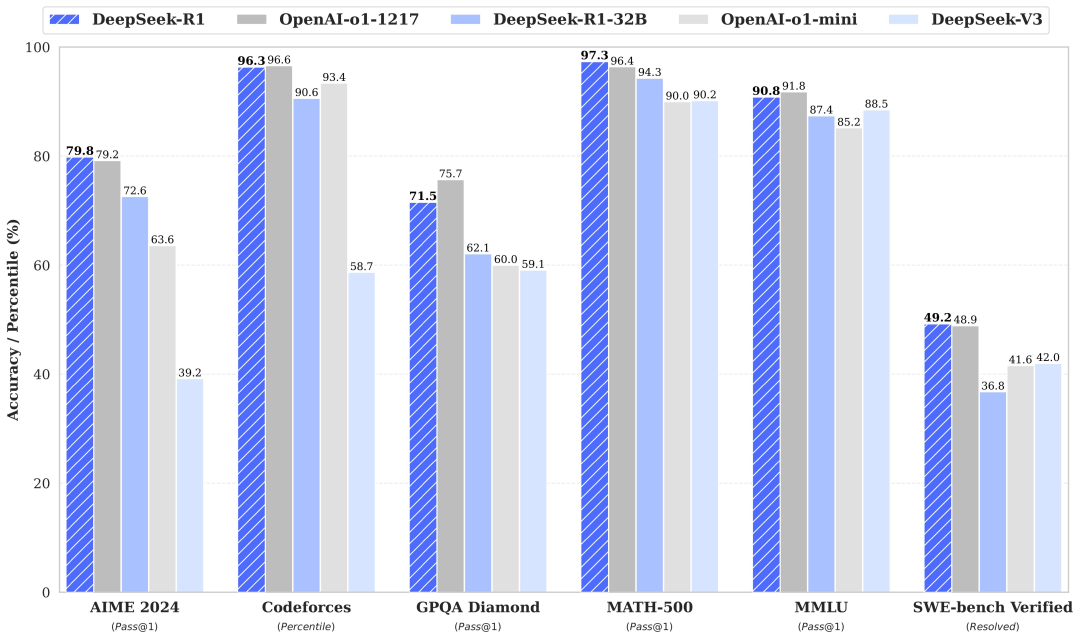

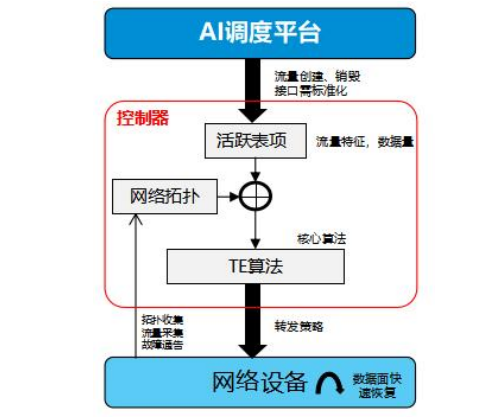

根据算侧任务流量特征及网络负载状态进行全局路径规划和控制。如图所示,网络控制器可通过API接口接收算侧调度平台传递的流量特征信息,基于特征信息进行路径的预规划。

本地自适应路由,交换机本地根据出口负载状态,动态选择出口。在全局规划的前提下,主要针对网络突发事件引起的瞬时流量不均,及时对路径进行局部调整。

远端自适应路由通知,在本地无其他满足条件的可用路径时,通过数据面报文通知上游节点进行切换,完成远端路径快速调整。在负载均衡的粒度选择方面,主要的考虑如下:

逐包喷洒均匀度最好,但端侧乱序重排需要较大的缓存,同时还要兼顾时延和实现成本;此外逐包喷洒的情况下还需要考虑防止故障半径的扩散,以及不固定的转发路径对网络运维带来的难度。

传统的每流基于五元组哈希方式在AI训练场景下容易导致哈希极化和负载不均,但配合层次化负载均衡技术,从全局视角尽可能将大流分担到不同链路上,避免同一时间多个大流共用链路,也可以以较小的实现代价提升网络中流量的均衡度。

新型转发技术为网络负载均衡提供了其他的粒度。例如在分布式全调度网络技术路线中,流量按报文单元或容器对报文进行转发,通过对报文单元的路径编排,在尽可能保序的同时也提供了较好的负载均衡效果。

随着高性能网络规模的不断扩展,一个高性能网络所覆盖的范围已经不局限于单个数据中心机房,甚至不局限于单个数据中心楼宇或单个数据中心园区。在这些情况下,由流量接收端来向流量发送端反馈拥塞通知已经不能满足极致低时延的要求,这就需要引入快速CNP功能。快速CNP是由检测到拥塞的中间交换机直接向发送端反馈拥塞通告,而无需先把拥塞情况告知接收端,再由接收端向发送端反馈。这种拥塞通告反馈链的缩短在长距离RDMA应用场景下能带来显著的收益。目前,业界已有多种私有的快速CNP技术方案,这些方案一个共同的缺陷就是要求发送端和交换机来自同一供应商,不利于快速CNP方案的灵活部署,所以快速CNP方案的标准化就显得尤为必要。

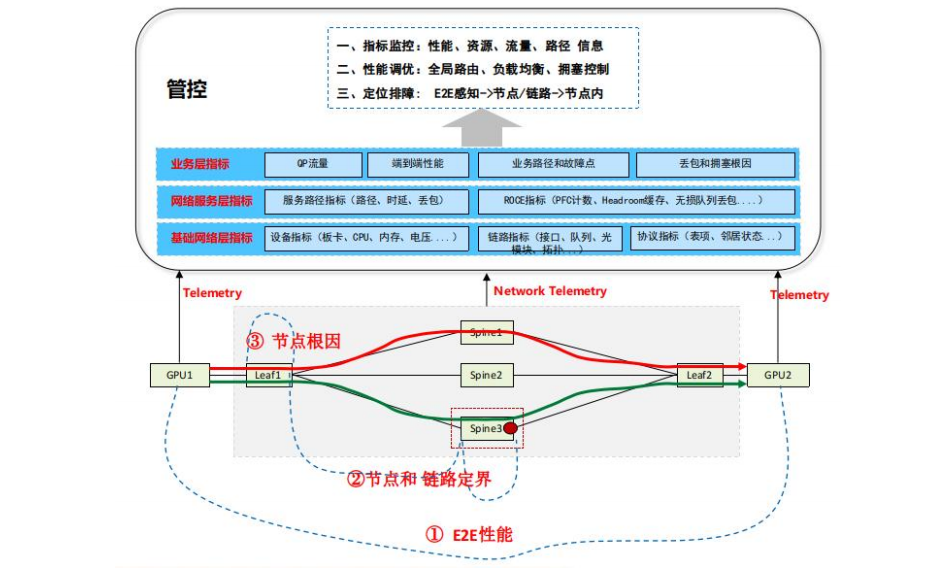

针对高性能网络的极致需求和挑战,应构建多维分层可观测性体系,并基于 Telemetry 技术,通过算侧和网侧的上报获取网络和业务相关分层指标:

基础网络层,主要检测物理网络的健康状态,主要包括三类指标:

1)设备指标:监控板卡、CPU/内存使用率及电压状态;

2)链路指标:跟踪接口报文计数、流量统计、队列信息、光模块详情及网络拓扑;

3)协议指标:检查协议状态、路由及邻居表,确保全面网络监控。通过大数据分析处理上述数据,实现健康评估、风险预测、性能KPI分析及拓扑管理等功能。

网络服务层,主要包括两类类指标:

1)服务路径指标:涵盖ECMP路径的时延与丢包详情,利用电信级OAM机制探测子路径状态,支持业务调整决策;

2)RoCE指标:监测PFC报文、队列占用情况、Headroom缓存状态及PFC死锁恢复次数。通过大数据分析上述采集数据,实现无损网络故障识别与风险预警,如PFC风暴检测、死锁预防及全网队列一致性检查。

业务层指标,通常以业务流为中心,观测业务流性能和路径、故障根因等信息,主要包括以下四类指标:

1)QP流量信息: AI大模型训练中流量模式同步性增强,粒度更细。通过计算或网络节点提供毫秒级业务流统计,包括五元组分析、队列状态监测及逐包字节计数等;

2)端到端性能评估: 获取AI训练场景下业务流实时丢包率与延迟数据,采用随流检测技术(如IOAM、INT或IFA),实现计算侧的全程性能监控;

3)网络路径与故障定界: 记录AI大模型训练业务流传输路径上的所有链路与节点,利用计算侧扩展的随流检测技术实现可视化管理和快速故障定位;

4)根因信息上报: 一方面采用MOD技术,覆盖Ingress、Egress和MMU环节,报告受影响流、事件时间、原因及数量。另一方面采用MOC技术,自动探测微秒级拥塞并精确捕捉突发情况,包括拥塞时间窗口、队列深度峰值及流量特征。

根据上述可观测指标,系统可实现三个综合维度能力:

(一)指标监控可视:实时掌握网络资源与业务动态,如端口占用、队列状态等,通过操作界面直观展示,预警潜在拥塞、丢包等问题,保障资源高效利用;

(二)业务性能调优:监控关键指标,优化网络与业务协同,精准调控拥塞管理及流量调度,确保算力与网络无缝对接,提升处理效能;

(三)故障排查加速:实施多层次故障检测,实现秒级故障定位与分钟级自动恢复,显著增强网络运维效率和可靠性,保证业务连续性。

智算中心网络的多维分层可观测性需求推动了Telemetry技术的革新。如图所示,新一代数据面Telemetry需超越传统限制,实现性能飞跃。传统方案通过控制面

CPU周期性轮询采集数据并封装成Telemetry格式,但这种方法效率低下、实时性差且扩展性不足,已无法满足现代网络对高精度、低延迟及可扩展性的严格要求。

面向高性能网络的发展趋势,Telemetry技术将聚焦于以下关键领域:

1)优化芯片算力利用:通过芯片算法与设计创新,在确保信息压缩的同时推动Push源下沉芯片的架构,以实现更灵活的Telemetry格式与封装方式,满足多样化监测需求。平衡带宽消耗、设备资源利用与检测精度是核心挑战;

2)本地感知与智能化决策:全生命周期的业务检测与资源覆盖,在芯片级减少不必要的开销。借助高精度的数据感知结果,驱动本地节点实现智能分析与即时决策机制,显著提升网络效率及响应速度;

3)推进接口与封装标准化:标准化促进设备互操作性与生态融合,显著降低部署成本并提升系统兼容性和稳定性;

4)综合运用多种遥测技术:整合基于流、基于事件及混合型遥测方法,形成全面灵活的解决方案体系,增强网络观测能力,更好地支持智能计算网络的发展趋势。

总之,在构建面向未来的高性能网络可观测体系时,需持续推动芯片内置遥测功能的拓展与智能化升级;同时积极促进行业标准的制定与实施;并不断探索如何将不同遥测技术的优势互补结合,以期为智算网络持续赋能,并最终实现高效、精准且全面的网络运维和管理。

@大湾区国际数据中心大会暨展览会 版权所有